何邦武探讨人工智能法律主体质论,主张在现行法律体系下,人工智能不应被赋予法律主体资格。他认为,尽管人工智能具备一定程度的自主性,但仍无法与人类自然人的权利和责任等同。何邦武强调,应深入研究人工智能的法律地位问题,以确保法律体系的稳定与公正。

本文目录导读:

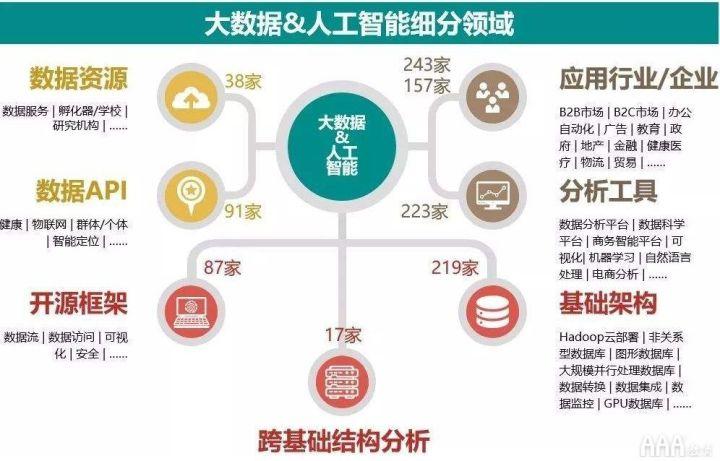

随着科技的飞速发展,人工智能(AI)已逐渐成为我们日常生活的重要组成部分,从智能家居到自动驾驶汽车,再到复杂的金融模型,AI的应用无处不在,深刻改变着我们的生活方式,这一技术的迅猛发展也带来了许多新的挑战,其中之一便是AI的法律主体地位问题,本文旨在探讨何邦武对于人工智能法律主体的观点,以及这一议题可能带来的深远影响。

人工智能与法律主体

在法律领域,主体通常指的是权利和义务的承担者,传统上,法律主体主要是指自然人和法人,随着人工智能技术的崛起,AI是否应被视为法律主体,能否承担权利和义务,已成为一个备受争议的话题。

何邦武认为,要确定AI的法律主体地位,首先需要明确AI在决策过程中的角色和责任分配,他强调,虽然AI可以自主做出决策,但这些决策是基于人类编程和训练数据的,AI的法律责任应与人类开发者、使用者的责任相区分。

何邦武观点:逐步确立AI的法律主体地位

何邦武认为,AI的法律主体地位不能一蹴而就,而应当逐步确立,他提出了以下观点:

1、明确AI的决策过程和责任归属,在AI做出决策时,应能够明确其决策的依据和逻辑,以便在出现问题时追究相关责任。

2、建立AI行为的规范和标准,通过制定法律法规,规范AI的开发、使用和传播,为AI的法律主体地位提供制度保障。

3、强化AI的透明度和可解释性,提高AI系统的透明度,使其决策过程更加透明可解释,有助于增强公众对AI的信任,也为法律主体责任的认定提供了可能。

4、培养AI伦理和道德意识,在AI的设计和开发过程中,融入伦理和道德因素,使其在面对道德和法律冲突时能够做出合理的决策。

挑战与机遇

确立AI的法律主体地位面临着诸多挑战,技术挑战包括如何确保AI决策的透明度和可解释性,以及如何培养AI的伦理和道德意识,法律框架、社会接受度、隐私保护等问题也是亟待解决的难题,这也带来了许多机遇,确立AI的法律主体地位将有助于推动科技创新,促进经济发展,提高社会效率,这也将促使我们重新审视现有的法律体系,以适应未来的科技发展。

案例研究

为了更好地理解AI法律主体地位的问题,我们可以借鉴一些实际案例,自动驾驶汽车的事故责任认定就是一个典型的案例,当自动驾驶汽车因系统故障或误判而导致事故时,责任应归咎于汽车的所有者、开发者还是AI系统本身?这需要我们从法律角度进行深入探讨。

何邦武认为,虽然确立AI的法律主体地位面临诸多挑战,但我们应当逐步推进这一进程,通过明确AI的决策过程和责任归属、建立AI行为的规范和标准、强化AI的透明度和可解释性、培养AI的伦理和道德意识等措施,逐步确立AI的法律主体地位,这将为我们应对未来的科技挑战提供法律保障,推动科技创新和经济发展。

展望

随着AI技术的进一步发展,AI法律主体的问题将更加突出,我们需要不断完善相关法律法规,以适应科技发展的需要,我们也需要加强公众对AI的认知和了解,提高社会对AI的接受度,何邦武的观点为我们提供了一个有益的视角,让我们更加深入地思考如何确立AI的法律主体地位,我相信,在不久的将来,我们将找到一个平衡点,使AI在法律的框架内发挥出更大的潜力。

基于以上分析,我提出以下建议:

1、加强研究:进一步深入研究AI法律主体的问题,借鉴国际先进经验,结合我国实际情况,制定符合国情的法律法规。

2、公众参与:加强公众对AI的认知和了解,鼓励公众积极参与讨论,提高社会对AI的接受度。

3、政策支持:政府应出台相关政策,支持AI技术的发展,同时确保技术的合法性和伦理性。

4、企业责任:企业应承担起社会责任,加强自律,确保AI技术的合法、伦理性应用。

在人工智能飞速发展的时代,确立AI的法律主体地位是一个长期而复杂的过程,我们需要不断探索、实践和完善,以适应科技发展的需要,何邦武的观点为我们提供了一个有益的视角,让我们更加深入地思考这一问题,我相信,在各方共同努力下,我们将逐步确立AI的法律主体地位,为人工智能的健康发展提供法律保障。

京公网安备11000000000001号

京公网安备11000000000001号 京ICP备11000001号

京ICP备11000001号

还没有评论,来说两句吧...